Actualidad

ChatGPT suma “contacto de confianza” para alertar ante riesgo de autolesión

OpenAI lanzó una función opcional para adultos que permite avisar a una persona elegida si el sistema detecta una posible situación grave de riesgo.

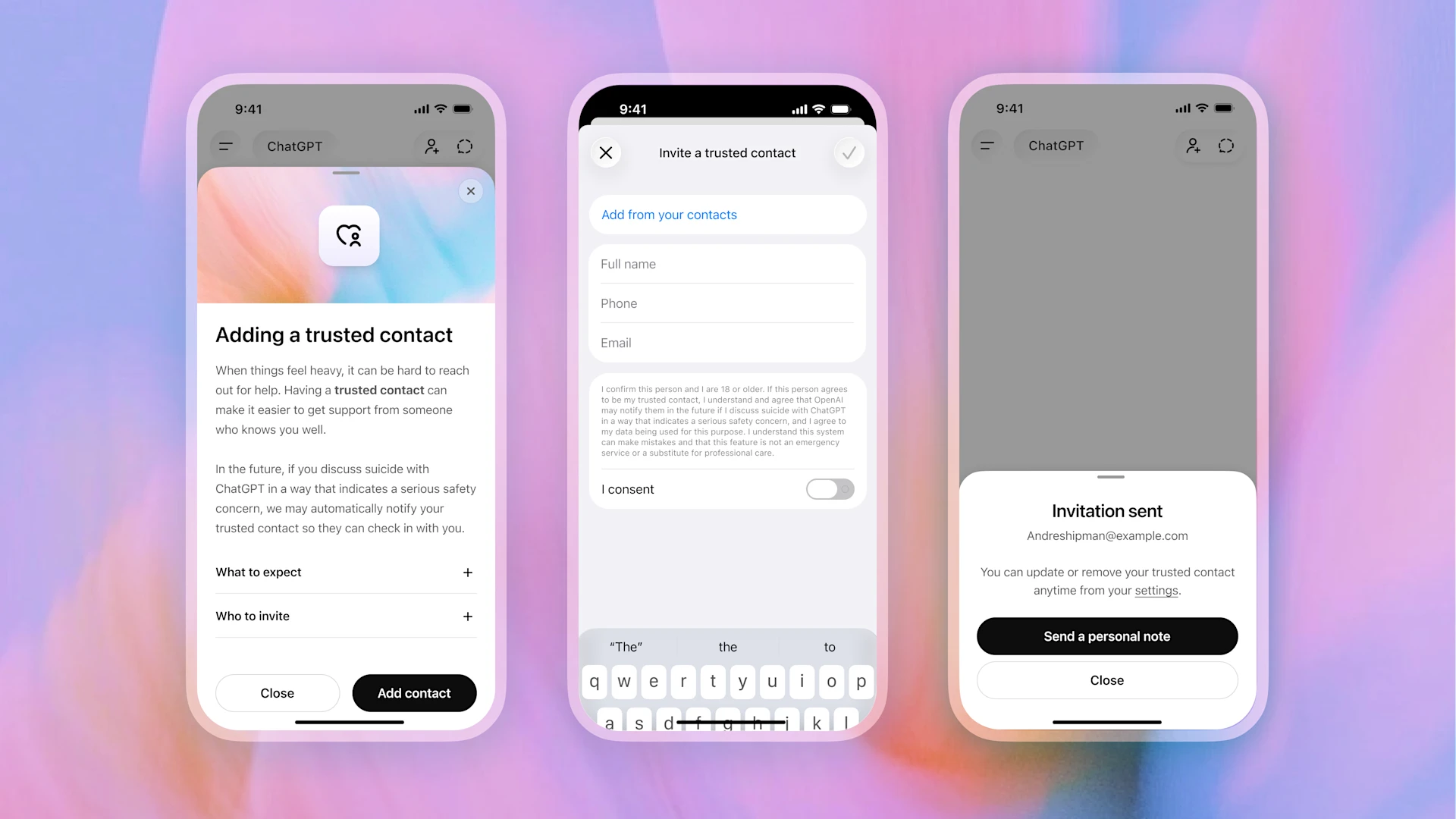

OpenAI comenzó a desplegar Trusted Contact, una nueva función de seguridad en ChatGPT que permite a usuarios adultos designar a una persona de confianza para recibir una alerta ante una posible situación de autolesión o crisis. La herramienta fue anunciada el 7 de mayo y apunta a conectar a la persona con ayuda real cuando el sistema detecte señales de riesgo.

La compañía explicó que la opción estará disponible para mayores de 18 años. En Corea del Sur, el requisito será tener al menos 19 años.

El contacto elegido puede ser un familiar, amigo, cuidador u otra persona cercana. Para que la función quede activa, esa persona debe aceptar una invitación dentro del plazo de una semana.

Cómo funciona la nueva herramienta

Según informó OpenAI, el usuario podrá agregar un solo adulto como contacto de confianza desde la configuración de ChatGPT. Si esa persona rechaza la invitación o no responde a tiempo, el usuario podrá elegir otro contacto.

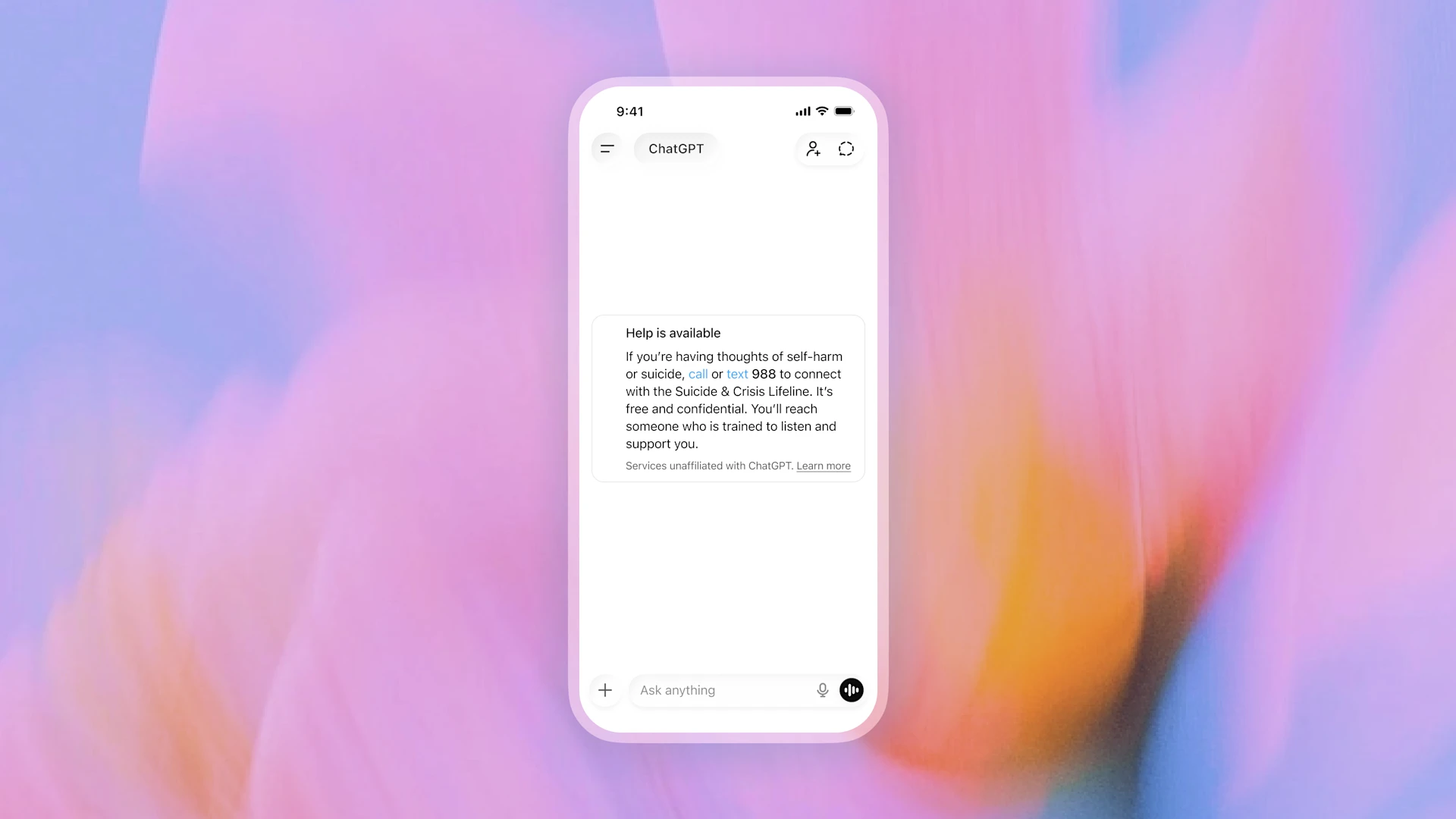

En caso de que los sistemas automáticos detecten una conversación vinculada con autolesión y la interpreten como una posible preocupación grave, ChatGPT avisará primero al usuario. Además, lo alentará a comunicarse con su contacto y podrá sugerir frases para iniciar esa conversación.

El proceso no será completamente automático. OpenAI indicó que “un pequeño equipo de personas especialmente capacitadas” revisará la situación antes de enviar cualquier aviso.

Revisión humana y privacidad

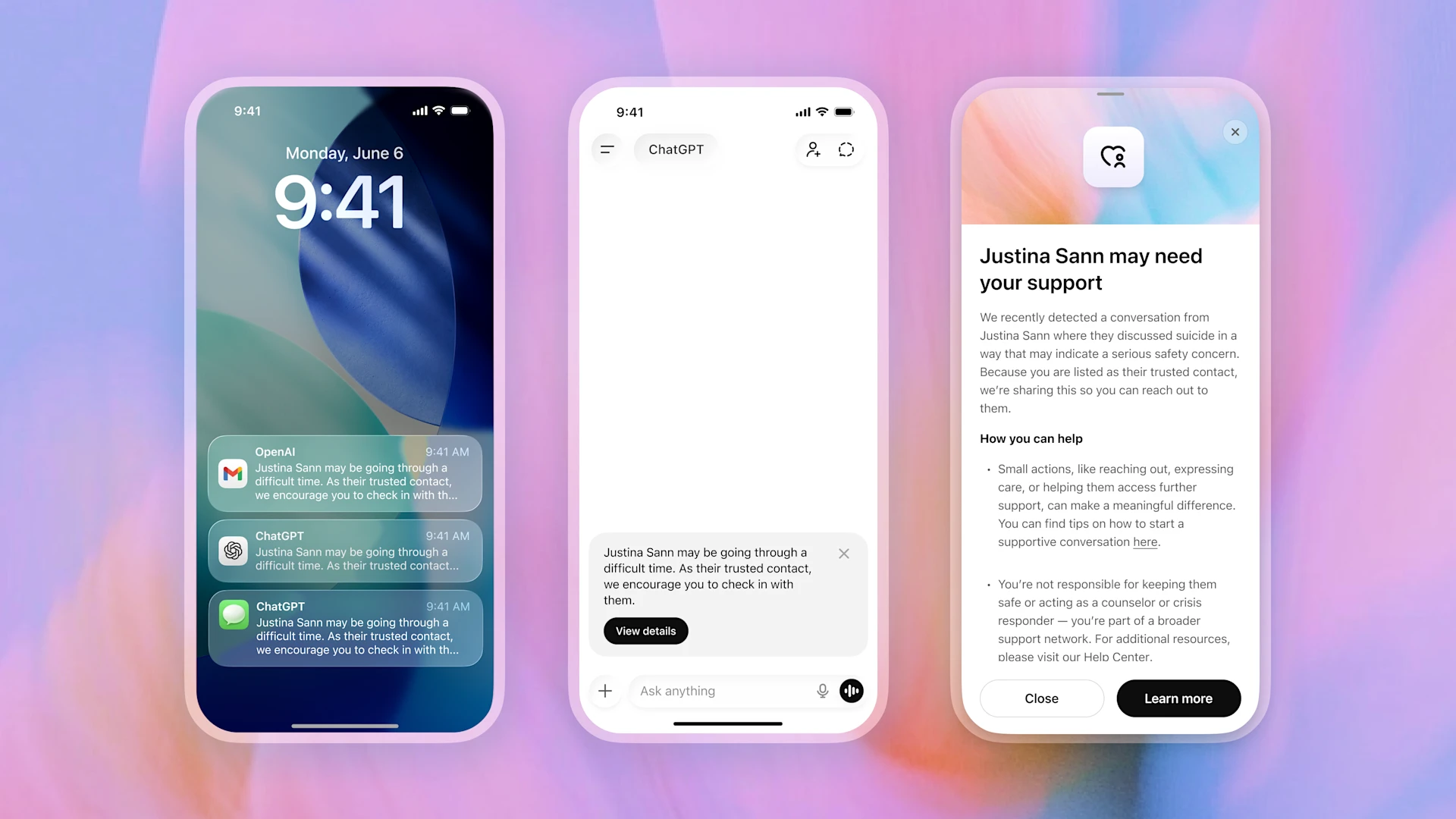

Si los revisores concluyen que existe una preocupación seria de seguridad, ChatGPT enviará una notificación breve al contacto designado. El aviso podrá llegar por correo electrónico, mensaje de texto o notificación dentro de la aplicación.

La empresa aclaró que la notificación será limitada. Informará que surgió una posible situación relacionada con autolesión y recomendará al contacto comunicarse con la persona.

OpenAI sostuvo que no compartirá detalles ni transcripciones de la conversación, con el objetivo de proteger la privacidad del usuario.

“Si bien ningún sistema es perfecto, cada notificación pasa por una revisión humana capacitada antes de enviarse”, señaló la compañía. Además, afirmó que busca revisar estas alertas en menos de una hora.

Un refuerzo para casos de crisis

La nueva función se suma a otros recursos de seguridad de ChatGPT, como las líneas de ayuda localizadas y los controles parentales. OpenAI ya había incorporado alertas para padres o tutores cuando se detectan señales de angustia aguda en cuentas adolescentes vinculadas.

La empresa también indicó que trabajó con médicos, investigadores y organizaciones de salud mental para desarrollar esta herramienta. Entre ellos mencionó a la American Psychological Association y a una red global de más de 260 médicos con licencia en 60 países.

“Conectar a las personas con alguien de confianza puede ser clave en momentos de vulnerabilidad”, planteó OpenAI al presentar la función.

La medida llega en un contexto de mayor uso de chatbots para conversaciones personales y de salud mental. Por eso, la empresa remarcó que Trusted Contact no reemplaza la atención profesional ni los servicios de emergencia, sino que busca sumar una capa de apoyo ante situaciones graves.