Actualidad

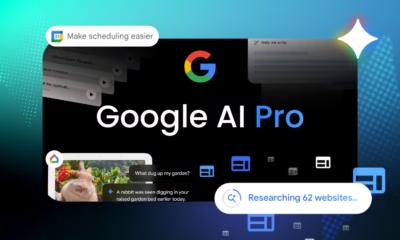

Google lleva la IA de Gemini a otro nivel: podrá armar pedidos y reservas en apps desde Galaxy S26 y Pixel 10

La nueva función de automatización de tareas permitirá que Gemini navegue aplicaciones como Uber, DoorDash o Grubhub en una ventana virtual, con lanzamiento inicial en Estados Unidos y Corea del Sur.

Google presentó este miércoles una nueva capa de funciones de IA para Android: la app Gemini sumará capacidades “agénticas” para ejecutar pasos dentro de aplicaciones y dejar listas acciones como pedir un viaje o preparar un pedido de comida, con llegada primero a la serie Samsung Galaxy S26 y luego a los Google Pixel 10 mediante actualización de software.

Según la demostración, el usuario inicia el proceso con un pedido en lenguaje natural —por ejemplo, “conseguime un Uber al aeropuerto”— y Gemini abre la app en una ventana virtual para completar el recorrido paso a paso. La persona puede mirar el proceso en tiempo real, frenarlo o tomar el control cuando lo necesite.

En esta etapa, Gemini no confirma la compra por su cuenta: al final avisa y deja al usuario la decisión final, como elegir la categoría del viaje, revisar el precio y tocar “confirmar” o “ordenar”.

Cómo funcionará la “automatización de tareas” en Android

En la práctica, la novedad apunta a lo que Google describe como tareas repetitivas del día a día. El presidente del Android Ecosystem en Google, Sameer Samat, lo definió como “digital laundry”, en referencia a acciones necesarias pero poco atractivas de hacer manualmente.

El sistema también contempla situaciones de ambigüedad: si faltan datos (por ejemplo, qué aeropuerto elegir en una zona con varias opciones), la asistencia vuelve a consultar antes de seguir.

Google explicó que la tecnología combina la capacidad de razonamiento del modelo con distintos “niveles” de integración: desde acciones expuestas por desarrolladores mediante marcos como MCP o el framework de app functions de Android, hasta casos donde el asistente intenta “entender” la interfaz y avanzar igual.

Disponibilidad, límites y alertas de privacidad

El despliegue arrancará como early preview en EE.UU. y Corea del Sur, primero en los Galaxy S26 (con lanzamiento previsto para el 11 de marzo) y más adelante como actualización para la serie Pixel 10.

Por ahora, el soporte se concentra en un grupo reducido de apps, con ejemplos como Uber y servicios de pedidos de comida. Google anticipa que habrá más compatibilidad “más adelante” y lo vinculó con el avance de Android 17.

Informes previos sobre esta función —mencionada como “screen automation”— ya advertían que Google mostrará avisos de uso responsable: supervisión del usuario, posibles errores y recomendaciones de no usarla en emergencias o con información sensible.

De fondo, la compañía plantea un cambio de enfoque: pasar de pensar Android como un sistema operativo a tratarlo como un “sistema de inteligencia”, con asistentes capaces de operar apps de forma más autónoma.

El próximo paso será ver cuán rápido se amplía el catálogo de aplicaciones compatibles y qué alcance real tendrá la automatización cuando llegue Android 17.